Bedingter Erwartungswert

Der bedingte Erwartungswert beschreibt in der Wahrscheinlichkeitstheorie und Statistik den Erwartungswert einer Zufallsvariablen unter der Voraussetzung, dass noch zusätzliche Informationen über den Ausgang des zugrunde liegenden Zufallsexperiments verfügbar sind. Dabei kann die Bedingung beispielsweise darin bestehen, dass bekannt ist, ob ein gewisses Ereignis eingetreten ist oder welche Werte eine weitere Zufallsvariable angenommen hat; abstrakt kann die Zusatzinformation als Unterraum des zugrunde liegenden Ereignisraums aufgefasst werden.

Abstrakte bedingte Erwartungswerte und als Spezialfall davon bedingte Wahrscheinlichkeiten verallgemeinern in der Wahrscheinlichkeitstheorie und Statistik den elementaren Begriff der bedingten Wahrscheinlichkeit.

Bedingte Erwartungswerte spielen eine wichtige Rolle in der modernen Stochastik, beispielsweise bei der Untersuchung stochastischer Prozesse, und werden unter anderem bei der Definition von Martingalen verwendet.

Interpretation

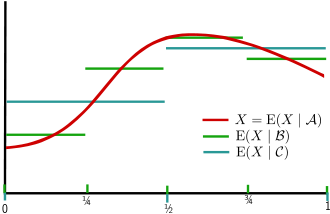

Die Bildung des bedingten Erwartungswertes ist gewissermaßen eine Glättung einer Zufallsvariablen auf einer Teil-σ-Algebra. σ-Algebren modellieren verfügbare Information, und eine geglättete Version der Zufallsvariable, die schon auf einer Teil-σ-Algebra messbar ist, enthält weniger Information über den Ausgang eines Zufallsexperimentes. Mit der Bildung der bedingten Erwartung geht eine Reduktion der Beobachtungstiefe einher, die bedingte Erwartung reduziert die Information über eine Zufallsvariable auf eine in Hinsicht der Messbarkeit einfachere Zufallsvariable, ähnlich wie als Extremfall der Erwartungswert einer Zufallsvariablen die Information auf eine einzelne Zahl reduziert.

Geschichte

Das in einigen Aspekten sehr alte Konzept (schon Laplace hat bedingte Dichten berechnet) wurde von Andrei Kolmogorow 1933 unter Verwendung des Satzes von Radon-Nikodym formalisiert. In Arbeiten von Paul Halmos 1950 und Joseph L. Doob 1953 wurden bedingte Erwartungen auf die heute übliche Form von Teil-σ-Algebren auf abstrakten Räumen übertragen.

Einleitung

Wenn ein Ereignis

mit

gegeben ist, gibt die bedingte

Wahrscheinlichkeit

an, wie wahrscheinlich das Ereignis

ist, wenn man die Information hat, dass das Ereignis

eingetreten ist. Entsprechend gibt der bedingte Erwartungswert

an, welchen Wert man für die Zufallsvariable

im Mittel erwartet,

wenn man die Information hat, dass das Ereignis

eingetreten ist. Hierbei ist

die Indikatorfunktion

von

,

also die Zufallsvariable, die den Wert

annimmt, wenn

eintritt, und

,

wenn nicht.

Beispiel:

sei die Augenzahl beim Werfen eines regelmäßigen Würfels und

sei das Ereignis, eine 5 oder 6 zu würfeln. Dann ist

.

Dieser elementare Begriff von bedingten Wahrscheinlichkeiten und Erwartungswerten ist jedoch oft nicht ausreichend. Gesucht sind häufig vielmehr bedingte Wahrscheinlichkeiten und bedingte Erwartungswerte in der Form

(a)

bzw.

,

-

- wenn man weiß, dass eine Zufallsvariable

einen Wert

hat,

- wenn man weiß, dass eine Zufallsvariable

(b)

bzw.

,

-

- wenn man den bei (a) gefundenen Wert als Zufallsvariable (in

Abhängigkeit von

) betrachtet,

- wenn man den bei (a) gefundenen Wert als Zufallsvariable (in

Abhängigkeit von

(c)

bzw.

,

-

- wenn man für jedes Ereignis in einer σ-Algebra

die Information hat, ob es eingetreten ist oder nicht.

- wenn man für jedes Ereignis in einer σ-Algebra

Die Ausdrücke in (b) und (c) sind im Gegensatz zu (a) selbst Zufallsvariablen, da

sie noch von der Zufallsvariable

bzw. der Realisierung der Ereignisse in

abhängen.

wird oft Erwartungswert von Y unter der Bedingung B gesprochen.

und

wird Erwartungswert von Y gegeben X bzw. Erwartungswert von Y gegeben

gesprochen.

Die angegebenen Varianten von bedingten Wahrscheinlichkeiten und Erwartungswerten sind alle miteinander verwandt. Tatsächlich genügt es, nur eine Variante zu definieren, denn alle lassen sich voneinander ableiten:

- Bedingte Wahrscheinlichkeiten und bedingte Erwartungswerte beinhalten das

gleiche: Bedingte Erwartungswerte lassen sich, genau wie gewöhnliche Erwartungswerte, als

Summen oder Integrale aus bedingten Wahrscheinlichkeiten berechnen.[1]

Umgekehrt ist die bedingte Wahrscheinlichkeit eines Ereignisses einfach der

bedingte Erwartungswert der Indikatorfunktion

des Ereignisses:

.

- Die Varianten in (a) und (b) sind äquivalent. Die Zufallsvariable

weist für das Ergebnis

den Wert

auf, d.h. man erhält für

den Wert

, wenn man für

den Wert

beobachtet. Umgekehrt kann man, wenn

gegeben ist, immer einen von

abhängigen Ausdruck

finden, so dass diese Beziehung erfüllt ist.[2] Entsprechendes gilt für bedingte Erwartungswerte.

- Die Varianten in (b) und (c) sind ebenfalls äquivalent, weil man

als die Menge aller Ereignisse der Form

wählen kann (die von

erzeugte σ-Algebra

), und umgekehrt

als die Familie

. [3]

Diskreter Fall

Wir betrachten hier den Fall, dass

für alle Werte

von

gilt. Dieser Fall ist besonders einfach zu behandeln, weil die elementare

Definition uneingeschränkt anwendbar ist:

Die Funktion

(wobei

das Argument bezeichnet) besitzt alle Eigenschaften eines Wahrscheinlichkeitsmaßes,

es handelt sich um eine sogenannte reguläre bedingte Wahrscheinlichkeit.

Die bedingte

Verteilung

einer Zufallsvariable

ist daher ebenfalls eine ganz gewöhnliche Wahrscheinlichkeitsverteilung.

Der Erwartungswert dieser Verteilung ist der bedingte Erwartungswert von

,

gegeben

:

Ist

ebenfalls diskret, so gilt

wobei über alle

im Wertebereich von

summiert wird.

Beispiel

und

seien die Augenzahlen bei zwei unabhängigen Würfen mit einem regelmäßigen Würfel

und

die Augensumme. Die Verteilung von

ist gegeben durch

,

.

Wenn wir aber das Ergebnis

des ersten Wurfs kennen und wissen, dass wir z.B. den Wert

gewürfelt haben, erhalten wir die bedingte Verteilung

.

Der Erwartungswert dieser Verteilung, der bedingte Erwartungswert von ,

gegeben

,

ist

.

Allgemeiner gilt für beliebige Werte

von

.

Wenn wir für

den Wert von

einsetzen, erhalten wir den bedingten Erwartungswert von

,

gegeben

:

.

Dieser Ausdruck ist eine Zufallsvariable; wenn das Ergebnis

eingetreten ist, weist

den Wert

auf und

den Wert

.

Satz über die totale Wahrscheinlichkeit

Die Wahrscheinlichkeit eines Ereignisses

lässt sich durch Zerlegen nach den Werten

von

berechnen:

Allgemeiner gilt für jedes Ereignis

in der σ-Algebra

die Formel

.

Mithilfe der Transformationsformel für das Bildmaß erhält man die äquivalente Formulierung

.

Allgemeiner Fall

Im allgemeinen Fall ist die Definition weit weniger intuitiv als im diskreten

Fall, weil man nicht mehr voraussetzen kann, dass die Ereignisse, auf die man

bedingt, eine Wahrscheinlichkeit

haben.

Ein Beispiel

Wir betrachten zwei unabhängige

standardnormalverteilte

Zufallsvariablen

und

.

Ohne große Überlegung kann man auch hier den bedingten Erwartungswert, gegeben

,

der Zufallsvariablen

angeben, d.h. den Wert, den man im Mittel für den Ausdruck

erwartet, wenn man

kennt:

bzw.

Wie zuvor ist

selbst eine Zufallsvariable, für deren Wert nur die von

erzeugte σ-Algebra

entscheidend ist. (Setzt man etwa

,

also

,

so erhält man ebenfalls

.)

Die Problematik ergibt sich aus folgender Überlegung: Die angegebenen

Gleichungen gehen davon aus, dass

für jeden einzelnen Wert von

standardnormalverteilt ist. Tatsächlich könnte man aber auch annehmen, dass

im Fall

konstant den Wert

hat und nur in den übrigen Fällen standardnormalverteilt ist: Da das Ereignis

die Wahrscheinlichkeit

hat, wären

und

insgesamt immer noch unabhängig und standardnormalverteilt. Man erhielte aber

statt

.

Das zeigt, dass der bedingte Erwartungswert nicht eindeutig festgelegt ist, und

dass es nur sinnvoll ist, den bedingten Erwartungswert für alle Werte von

simultan zu definieren, da man ihn für einzelne Werte beliebig abändern

kann.

Der Ansatz von Kolmogorow

Nachdem sich die elementare Definition nicht auf den allgemeinen Fall übertragen lässt, stellt sich die Frage, welche Eigenschaften man beibehalten möchte und auf welche man zu verzichten bereit ist. Der heute allgemein übliche Ansatz, der auf Kolmogorow (1933) zurückgeht[4] und der sich insbesondere in der Theorie der stochastischen Prozesse als nützlich erwiesen hat, verlangt nur zwei Eigenschaften:

(1)

soll eine messbare

Funktion von

sein. Auf die σ-Algebra

übertragen bedeutet dies, dass

eine

-messbare

Zufallsvariable sein soll.

(2) In Analogie zum Satz über die totale Wahrscheinlichkeit soll für jedes

die Gleichung

erfüllt sein.

Nicht gefordert wird unter anderem

- dass bedingte Wahrscheinlichkeiten eindeutig festgelegt sind,

- dass

stets ein Wahrscheinlichkeitsmaß ist,

- die Eigenschaft

.

Für bedingte Erwartungswerte hat (2) die Form

für alle Mengen ,

für die die Integrale definiert sind. Mit Indikatorfunktionen

lässt sich diese Gleichung schreiben als

.

In dieser Form wird die Gleichung in der folgenden Definition verwendet.

Formale Definition

Gegeben sei ein Wahrscheinlichkeitsraum

und eine Teil-σ-Algebra

.

(1)

sei eine Zufallsvariable, deren Erwartungswert existiert. Der bedingte

Erwartungswert von

,

gegeben

,

ist eine Zufallsvariable

,

die die beiden folgenden Bedingungen erfüllt:

ist

-messbar und

- für alle

gilt

.

Zwei verschiedene bedingte Erwartungswerte von

gegeben

(„Versionen des bedingten Erwartungswerts“) unterscheiden sich höchstens auf

einer (in

enthaltenen) Nullmenge. Dadurch lässt sich

die einheitliche Schreibweise

für einen bedingten Erwartungswert

von

gegeben

rechtfertigen.

Die Schreibweise

bezeichnet den bedingten Erwartungswert von

,

gegeben die von den Zufallsvariablen

erzeugte

σ-Algebra

.

(2) Die bedingte Wahrscheinlichkeit eines Ereignisses ,

gegeben

,

ist definiert als die Zufallsvariable

,

d.h. als der bedingte Erwartungswert der Indikatorfunktion von .

Da die bedingten Wahrscheinlichkeiten

verschiedener Ereignisse

somit ohne Bezug zueinander definiert sind und nicht eindeutig festgelegt sind,

muss

im Allgemeinen kein Wahrscheinlichkeitsmaß

sein. Wenn dies jedoch der Fall ist, d.h. wenn man die bedingten

Wahrscheinlichkeiten

,

zu einem stochastischen

Kern

von

nach

zusammenfassen kann,

für alle

,

spricht man von regulärer bedingter Wahrscheinlichkeit. Eine konkrete Version des bedingten Erwartungswertes ist dann als Integral

gegeben.

Faktorisierung:

Der bedingte Erwartungswert ,

der als eine Zufallsvariable (also eine Funktion von

)

definiert ist, lässt sich auch als eine Funktion von

darstellen: Es gibt eine messbare

Funktion

,

so dass

für alle

.

Damit kann man formal auf einzelne Werte bedingte Erwartungswerte definieren:

.

Bei der Verwendung solcher Ausdrücke ist wegen der fehlenden Eindeutigkeit im allgemeinen Fall besondere Vorsicht geboten.

Existenz: Die allgemeine Existenz von bedingten Erwartungswerten für

integrierbare

Zufallsvariablen (Zufallsvariablen, die einen endlichen Erwartungswert

besitzen), also insbesondere von bedingten Wahrscheinlichkeiten, folgt aus dem

Satz

von Radon-Nikodým; die Definition besagt nämlich nichts anderes, als dass

eine Dichte des signierten Maßes

bezüglich des Maßes

ist, beide definiert auf dem Messraum

.

Die Definition lässt sich noch geringfügig verallgemeinern, so dass man auch

Fälle wie

für eine Cauchy-verteilte

Zufallsvariable erfassen kann.[1]

Reguläre bedingte Wahrscheinlichkeiten, auch in faktorisierter Form,

existieren in polnischen

Räumen mit der Borel-σ-Algebra,

allgemeiner gilt: Ist

eine beliebige Zufallsvariable mit Werten in einem polnischen Raum, so existiert

eine Version der Verteilung

in der Form eines stochastischen Kerns

:

für alle

Spezialfälle

(1) Für die triviale σ-Algebra

ergeben sich einfache Erwartungswerte und Wahrscheinlichkeiten:

für alle

für alle

Entsprechend gilt

und

für alle

bei Bedingen auf den Wert einer konstanten Zufallsvariable

.

(2) Einfache σ-Algebren: Ist

mit

,

und besitzt

außer sich selbst und der leeren Menge keine Teilmengen in

,

so stimmt der Wert von

auf

mit der herkömmlichen bedingten

Wahrscheinlichkeit überein:

für alle

Das zeigt, dass die oben aufgeführten Berechnungen im diskreten Fall mit der allgemeinen Definition konsistent sind.

(3) Rechnen mit Dichten: Ist

eine beschränkte Dichtefunktion

der gemeinsamen

Verteilung von Zufallsvariablen

,

so ist

eine Dichte einer regulären bedingten Verteilung

in der faktorisierten Form und für den bedingten Erwartungswert gilt

.

(4) Auch in den folgenden Fällen lassen sich reguläre bedingte Verteilungen angeben:

- wenn

unabhängig von

ist, in der Form

,

- wenn

-messbar ist, in der Form

(Diracmaß),

- für das Paar

, wenn

-messbar ist, in der Form

, sofern zur Berechnung des Ausdrucks auf der rechten Seite eine reguläre bedingte Verteilung von

verwendet wird.

Rechenregeln

Alle folgenden Aussagen gelten nur fast

sicher (-fast

überall), soweit sie bedingte Erwartungswerte enthalten. Anstelle von

kann man auch eine Zufallsvariable schreiben.

- Herausziehen unabhängiger Faktoren:

- Ist

unabhängig von

, so gilt

.

- Ist

unabhängig von

und von

, so gilt

.

- Sind

unabhängig,

unabhängig,

von

und

von

unabhängig, so gilt

- Ist

- Herausziehen bekannter Faktoren:

- Ist

-messbar, so gilt

.

- Ist

-messbar, so gilt

.

- Ist

- Totaler Erwartungswert:

.

- Turmeigenschaft: Für Teil-σ-Algebren

gilt

.

- Linearität: Es gilt

und

für

.

- Monotonie: Aus

folgt

.

- monotone

Konvergenz: Aus

und

folgt

.

- Dominierte

Konvergenz: Aus

und

mit

folgt

.

- Lemma

von Fatou: Aus

folgt

.

- Jensensche

Ungleichung: Ist

eine konvexe Funktion, so gilt

.

- Bedingte Erwartungswerte als

-Projektionen: Die vorherigen Eigenschaften (insbesondere das Herausziehen bekannter Faktoren und die Turmeigenschaft) implizieren für

-messbares

,

- d.h. der bedingte Erwartungswert

ist im Sinne des Skalarprodukts von L2(P) die orthogonale Projektion von

auf den Untervektorraum der

-messbaren Funktionen. Die Definition und der Beweis der Existenz der bedingten Erwartung kann über diesen Zugang auch auf der Theorie der Hilbert-Räume und dem Projektionssatz aufgebaut werden.

- Bedingte

Varianz: Mithilfe bedingter Erwartungswerte kann analog zur Definition der

Varianz

als mittlere quadratische Abweichung vom Erwartungswert auch die bedingte

Varianz

betrachtet werden. Es gelten der Verschiebungssatz

-

- sowie die sogenannte Varianzzerlegung

.

- Martingalkonvergenz:

Für eine Zufallsvariable

, die einen endlichen Erwartungswert besitzt, gilt

, wenn entweder

eine aufsteigende Folge von Teil-σ-Algebren ist und

oder wenn

eine absteigende Folge von Teil-σ-Algebren ist und

.

Weitere Beispiele

(1) Wir betrachten das Beispiel aus dem diskreten Fall von oben.

und

seien die Augenzahlen bei zwei unabhängigen Würfen mit einem regelmäßigen Würfel

und

die Augensumme. Die Berechnung des bedingten Erwartungswerts von

,

gegeben

,

vereinfacht sich mithilfe der Rechenregeln; zunächst gilt

.

Weil

eine messbare Funktion von

ist und

unabhängig von

ist, gilt

und

.

Also erhalten wir

.

(2) Wenn

und

unabhängig und Poisson-verteilt

mit Parametern

und

sind, dann ist die bedingte Verteilung von

,

gegeben

,

eine Binomialverteilung

mit den Parametern

und

,

das heißt

Es gilt also

und somit

.

Anmerkungen

- ↑ a

b

Sehr allgemein kann man beispielsweise setzen

fast überall.

- ↑

Diese Faktorisierung

ist immer als messbare Funktion möglich. Sie ist im Allgemeinen nicht

eindeutig, wenn

nicht surjektiv ist.

- ↑

Die mathematische Formulierung geht von folgender

Abstraktion des Begriffs „bekannt“ aus: Wenn die Realisation einer

Zufallsvariable oder von Ereignissen bekannt ist, ist nicht automatisch jede

davon abhängige, sondern nur jede messbar

davon abhängige Größe ebenfalls bekannt (oder genauer nur solche, die eine σ-Algebra erzeugen,

die eine Teilmenge der anderen ist). In diesem Sinne eignen sich σ-Algebren

zur Beschreibung

von verfügbarer Information: Die σ-Algebra

besteht aus den Ereignissen, deren Realisation prinzipiell bekannt ist nach Erhalt der Information über den Wert von

. Die Menge

wird allgemein als eine σ-Algebra angenommen.

- ↑

A. Kolmogoroff: Grundbegriffe der

Wahrscheinlichkeitsrechnung. Springer, Berlin 1933. In der Einleitung des

Buches ist die Theorie der bedingten Wahrscheinlichkeiten und Erwartungen als

wesentliche Neuerung erwähnt. Für die Definition der bedingten

Wahrscheinlichkeit bezüglich einer Zufallsvariable

verwendet Kolmogorow (S. 42) die Gleichung

, d.h.

, die für jede Wahl von

mit

erfüllt sein soll (für das Bedingen auf

wird die elementare Definition verwendet). Im anschließenden Beweis der Existenz und Eindeutigkeit zeigt Kolmogorow, dass nach Multiplikation mit

die linke Seite der Gleichung mit

übereinstimmt, die rechte mit

, was den oben angegebenen Ausdrücken entspricht, er arbeitet dann allerdings auf der Ebene des Bildraums von

weiter. Bei bedingten Erwartungen ist die Vorgehensweise ähnlich.

© biancahoegel.de

Datum der letzten Änderung: Jena, den: 25.04. 2023