Zweistichproben-t-Test

Der Zweistichproben-t-Test ist ein Signifikanztest aus der mathematischen Statistik. In der üblichen Form prüft er anhand der Mittelwerte zweier Stichproben, ob die Mittelwerte zweier normalverteilter Grundgesamtheiten gleich oder verschieden voneinander sind.

Es gibt zwei Varianten des Zweistichproben-t-Tests:

- den für zwei unabhängige Stichproben mit gleichen Standardabweichungen

in beiden Grundgesamtheiten und

- den für zwei abhängige Stichproben.

Liegen zwei unabhängige Stichproben mit ungleichen Standardabweichungen in beiden Grundgesamtheiten vor, so muss der Welch-Test (s. u.) eingesetzt werden.

Grundidee

Der Zweistichproben-t-Test prüft (im einfachsten Fall) mit Hilfe der Mittelwerte

und

zweier Stichproben, ob die Erwartungswerte

und

der zugehörigen Grundgesamtheiten verschieden sind.

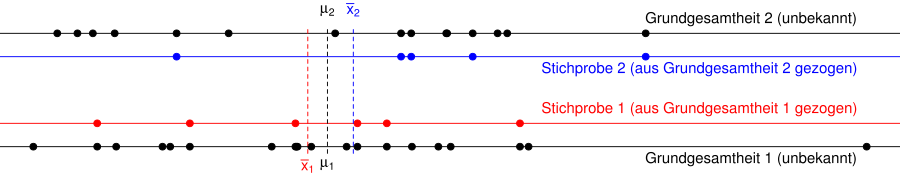

Die untenstehende Grafik zeigt zwei Grundgesamtheiten (schwarze Punkte) und zwei Stichproben (blaue und rote Punkte), die zufällig aus den Grundgesamtheiten

gezogen wurden. Die Mittelwerte der Stichproben

und

können aus den Stichproben berechnet werden, die Erwartungswerte der Grundgesamtheiten

und

sind jedoch unbekannt. In der Grafik sind die Grundgesamtheiten so konstruiert, dass die beiden Erwartungswerte gleich sind, also

.

Wir vermuten nun, z.B. aufgrund historischer Ergebnisse oder theoretischer Überlegungen, dass die Erwartungswerte

und

der Grundgesamtheiten verschieden sind, und möchten dies prüfen.

Im einfachsten Fall prüft der Zweistichproben-t-Test

- die Nullhypothese, dass die Erwartungswerte der Grundgesamtheiten gleich sind

(

)

- gegen die Alternativhypothese, dass die Erwartungswerte der

Grundgesamtheiten ungleich sind

(

).

Wenn die Stichproben geeignet gezogen wurden, zum Beispiel als einfache

Zufallsstichproben, wird der Mittelwert

der Stichprobe 1 mit hoher Wahrscheinlichkeit nahe dem Erwartungswert

der Grundgesamtheit 1 liegen und der Mittelwert

der Stichprobe 2 mit hoher Wahrscheinlichkeit nahe dem Erwartungswert

der Grundgesamtheit 2 liegen. Das heißt, der Abstand zwischen der gestrichelten roten und schwarzen Linie bzw. der gestrichelten blauen und schwarzen Linie

wird mit hoher Wahrscheinlichkeit klein sein.

- Wenn der Abstand zwischen

und

(gestrichelte blaue bzw. rote Linie) klein ist, dann liegen auch die Erwartungswerte der Grundgesamtheiten

und

nahe beieinander. Wir können die Nullhypothese nicht ablehnen.

- Wenn der Abstand zwischen

und

(gestrichelte blaue bzw. rote Linie) groß ist, dann liegen auch die Erwartungswerte der Grundgesamtheiten

und

weit voneinander entfernt. Wir können die Nullhypothese ablehnen.

Die genauen mathematischen Berechnungen finden sich in den folgenden Abschnitten.

Zweistichproben-t-Test für unabhängige Stichproben

Um Erwartungswertunterschiede zwischen zwei Grundgesamtheiten mit der gleichen unbekannten Standardabweichung

zu untersuchen, wendet man den Zweistichproben-t-Test an. Dafür muss jede der Grundgesamtheiten normalverteilt sein oder die Stichprobenumfänge müssen so groß sein, dass der zentrale Grenzwertsatz anwendbar ist. Für den Test zieht man eine Stichprobe

vom Umfang

aus der 1. Grundgesamtheit und unabhängig davon eine Stichprobe

vom Umfang

aus der 2. Grundgesamtheit. Für die zugehörigen unabhängigen Stichprobenvariablen

und

gilt dann

und

mit den Erwartungswerten

und

der beiden Grundgesamtheiten. Wird eine Zahl

für die Differenz der Erwartungswerte vorgegeben, so lautet die Nullhypothese

und die Alternativhypothese

.

Häufig liegt der Fall

vor, in welchem die Nullhypothese die Gleichheit der Erwartungswerte und die Alternativhypothese die Ungleichheit der

Erwartungswerte postuliert.

Die Teststatistik ergibt sich zu

Darin sind

und

die respektiven Stichprobenmittelwerte und

die gewichtete Varianz, berechnet als gewichtetes Mittel der respektiven korrigierten Stichprobenvarianzen

und

.

Die Teststatistik ist unter der Nullhypothese t-verteilt mit

Freiheitsgraden. Der Prüfwert, also die

Realisierung der Teststatistik anhand der Stichprobe, berechnet sich dann als

Dabei sind und

die aus der Stichprobe berechneten Mittelwerte und

die Realisierung der gewichteten Varianz, berechnet aus den Stichprobenvarianzen

und

.

Sie wird auch als gepoolte Stichprobenvarianz bezeichnet.

Zum Signifikanzniveau wird die Nullhypothese abgelehnt zugunsten der Alternative, wenn

Dabei bezeichnet das

-Quantil einer t-Verteilung mit

Freiheitsgraden. Im weiteren Verlauf des Artikels werden dafür auch die Notationen

und

verwendet. Im Artikel t-Verteilung wird dagegen die Notation

für das

-Quantil

einer t-Verteilung mit

Freiheitsgraden verwendet.

Alternativ können folgende Hypothesen mit der gleichen Teststatistik

getestet werden:

vs.

und die Nullhypothese wird abgelehnt, wenn

bzw.

vs.

und die Nullhypothese wird abgelehnt, wenn

.

Bemerkung[Bearbeiten | Quelltext bearbeiten]

Sind die Varianzen in den Grundgesamtheiten ungleich, dann muss der Welch-Test durchgeführt werden.

Beispiel 1

Zwei Düngemittelsorten sollen verglichen werden. Dazu werden 25 Parzellen gleicher Größe gedüngt, und zwar

Parzellen mit Sorte A und

Parzellen mit Sorte B. Angenommen wird, dass die Ernteerträge normalverteilt seien mit gleichen Varianzen. Bei Ersteren ergibt sich ein mittlerer Ernteertrag

mit Stichprobenvarianz

und bei den anderen Parzellen das Mittel

mit Varianz

. Für die gewichtete Varianz berechnet man damit

.

Daraus erhält man die Prüfgröße

.

Das vorgegebene Signifikanzniveau sei 5 %. Es wird ein zweiseitiger Test durchgeführt. Der Wert der Prüfgröße ist größer als das 0,975-Quantil der t-Verteilung mit

Freiheitsgraden

. Es kann also mit einer Konfidenz von

behauptet werden, dass ein Unterschied in der Wirkung der beiden Düngemittel besteht.

Kompaktdarstellung

| Zweistichproben-t-Test für zwei unabhängige Stichproben | |||

|---|---|---|---|

| Voraussetzungen |

| ||

| Hypothesen | (rechtsseitig) |

(zweiseitig) |

(linksseitig) |

| Teststatistik |

Im Fall | ||

| Prüfwert |

mit und | ||

| Ablehnungsbereich |

oder |

||

Zweistichproben-t-Test für abhängige Stichproben

Hier sind

und

zwei paarweise verbundene Stichproben,

die beispielsweise aus zwei Messungen an denselben Untersuchungseinheiten gewonnen wurden (Messwiederholung). Die Stichproben können auch aus anderen Gründen

paarweise abhängig sein, beispielsweise wenn die

- und

-Werte

Messergebnisse von Frauen bzw. Männern in einer Partnerschaft sind und Unterschiede zwischen den Geschlechtern interessieren.

Soll die Nullhypothese getestet werden, dass die beiden Erwartungswerte der zugrunde liegenden normalverteilten Grundgesamtheiten gleich sind, so können mit dem

Einstichproben-t-Test die Differenzen

auf Null getestet werden. In der Praxis muss bei kleineren Stichprobenumfängen

(

)

die Voraussetzung erfüllt sein, dass die Differenzen in der Grundgesamtheit normalverteilt sind. Bei hinreichend großen Stichproben verteilen sich die Differenzen

der Paare annähernd normal um das arithmetische Mittel der Differenz

der Grundgesamtheit. Insgesamt reagiert der t-Test auf Annahmeverletzung eher robust.

Beispiel 2

Um eine neue Therapie zur Senkung des Cholesterinspiegels zu testen, werden bei zehn Probanden vor und nach der Behandlung die Cholesterinwerte bestimmt. Es ergeben sich die folgenden Messergebnisse:

| Vor der Behandlung: | 223 | 259 | 248 | 220 | 287 | 191 | 229 | 270 | 245 | 201 |

| Nach der Behandlung: | 220 | 244 | 243 | 211 | 299 | 170 | 210 | 276 | 252 | 189 |

| Differenz: | 3 | 15 | 5 | 9 | −12 | 21 | 19 | −6 | −7 | 12 |

Die Differenzen der Messwerte haben das arithmetische Mittel

und die Stichprobenstandardabweichung

. Das ergibt als Prüfgrößenwert

.

Es ist , also gilt

.

Somit kann die Nullhypothese, dass die Erwartungswerte der Cholesterinwerte vor und nach der Behandlung gleich sind, die Therapie also keine Wirkung hat,

zum Signifikanzniveau

nicht abgelehnt werden.

Wegen

ist auch die einseitige Alternative, dass die Therapie den Cholesterinspiegel senkt, nicht signifikant. Wenn die

Behandlung überhaupt einen Effekt hat, so ist dieser nicht groß genug, um ihn mit einem so kleinen Stichprobenumfang zu entdecken.

Kompaktdarstellung

| Zweistichproben-t-Test für zwei gepaarte Stichproben | |||

|---|---|---|---|

| Voraussetzungen |

| ||

| Hypothesen | (rechtsseitig) |

(zweiseitig) |

(linksseitig) |

| Teststatistik | Im Fall | ||

| Prüfwert | mit und | ||

| Ablehnungsbereich |

|||

Welch-Test

Beim Welch-Test, der manchmal auch Satterthwaite-Test genannt wird, wird wie beim Zweistichprobentest-t-Test für unabhängige Stichproben unterstellt, dass die beiden Stichproben normalverteilt und unabhängig voneinander sind. Jedoch wird nicht mehr gefordert, dass die Varianzen in beiden Stichproben identisch sind. Die Teststatistik wird gegenüber dem Zweistichproben-t-Test entsprechend modifiziert:

Diese Teststatistik ist unter der Nullhypothese gleicher Mittelwerte nicht

-verteilt.

Die wahre Verteilung kann aber (auch für endliche Stichproben!) durch eine t-Verteilung

mit einer modifizierten Anzahl von Freiheitsgraden approximiert werden:

Dabei sind

und

die aus der Stichprobe geschätzten

Standardabweichungen der Grundgesamtheiten sowie

und

die Stichprobenumfänge.

Obwohl der Welch-Test speziell für den Fall

entwickelt wurde, funktioniert der Test nicht gut, wenn mindestens eine der Verteilungen nicht-normal ist, die Fallzahlen klein und stark unterschiedlich

(

) sind.

Kompaktdarstellung

| Welch-Test | |||

|---|---|---|---|

| Voraussetzungen |

| ||

| Hypothesen | (rechtsseitig) |

(zweiseitig) |

(linksseitig) |

| Teststatistik | Im Fall | ||

| Prüfwert | mit | ||

| Ablehnungsbereich |

oder |

||

Alternative Tests

Der t-Test wird, wie oben ausgeführt, zum Testen von Hypothesen über Erwartungswerte einer oder zweier Stichproben aus normalverteilten Grundgesamtheiten mit unbekannter Standardabweichung verwendet.

- Permutationstest, beruht nicht auf der Annahme, dass jede der beiden Gruppen für sich normalverteilt sind

- Die Annahme, dass jede der beiden Gruppen für sich normalverteilt ist, kann mit dem Shapiro-Wilk-Test oder dem Kolmogorow-Smirnow-Test geprüft werden. Liegt keine Normalverteilung vor, können als Ersatz für den t-Test nichtparametrische Tests angewendet werden, etwa ein Wilcoxon-Mann-Whitney-Test (auch: Wilcoxon-Rangsummentest) für unabhängige Stichproben oder ein Wilcoxon-Vorzeichen-Rang-Test für gepaarte Stichproben. Ein einfach durchführbares alternatives Verfahren zur schnellen Abschätzung ist der Schnelltest nach Tukey.

- Sollen mehr als zwei normalverteilte Stichproben auf Gleichheit der Erwartungswerte getestet werden, kann eine Varianzanalyse angewendet werden.

- Bei Mittelwertvergleichen normalverteilter Stichproben mit bekannter Standardabweichung können Gauß-Tests verwendet werden.

© biancahoegel.de

Datum der letzten Änderung: Jena, den: 04.10. 2023