Pixel

Mit Pixel, Bildpunkt, Bildzelle oder Bildelement (selten Pel) werden die einzelnen Farbwerte einer digitalen Rastergrafik bezeichnet sowie die zur Erfassung oder Darstellung eines Farbwerts nötigen Flächenelemente bei einem Bildsensor beziehungsweise Bildschirm mit Rasteransteuerung. „Pixel“ (Nominativ Singular: das Pixel; Genitiv: des Pixels; Plural: die Pixel) ist ein Kofferwort aus den Abkürzungen der englischen Wörter picture (umgangssprachlich verkürzt „pix“) und element und wird oft mit px abgekürzt.

Pixel der Rastergrafik

Die Pixel einer Rastergrafik sind rasterförmig angeordnete Punkte, denen eine Farbe zugeordnet ist.

Pixel als diskrete Abtastwerte

Oft werden Pixel als rechteckig oder quadratisch betrachtet. Dies ist jedoch eine nicht allgemeingültige Modellvorstellung. Im Sinne der digitalen Signalverarbeitung ist ein Pixel ein diskreter Abtastwert; über andere Punkte als die Pixel lassen sich keine Aussagen treffen. Deutlich wird dies bei der Vergrößerung von Rastergrafiken: Das Erscheinungsbild variiert je nach gewählter Skalierungsmethode, und die Pixel des Ausgangsbildes erscheinen in der Vergrößerung nicht zwangsläufig als Quadrate (siehe Bild rechts). Ein vergleichbarer Fehler wäre es, die Abtastwerte eines digitalen Audiosignals als über ein bestimmtes Zeitintervall gleichbleibende Werte zu interpretieren, weil das Signal vom Audioeditor in der Vergrößerung treppenartig dargestellt wird.

Die Modellvorstellung eines quadratischen Pixels ist unangemessen, weil sie die unterschiedlichen Möglichkeiten bei der Umwandlung von Bildinhalten zu Rastergrafiken vernachlässigt. In der Computergrafik, bei der künstliche Bilder erzeugt werden, können die gewünschten Bildinhalte als Vektorgrafik, 3D-Szenenbeschreibung oder eine andere Art der Bildbeschreibung vorliegen. Diese Bildbeschreibung definiert ein kontinuierliches Signal, das in eine Rastergrafik umgewandelt (gerastert oder gerendert) werden muss, indem die Bildinhalte abgetastet werden. Der verwendete Rekonstruktionsfilter bestimmt, wie die Farben der ursprünglichen Bildbeschreibung in der Nähe eines Pixels gewichtet werden und in die Pixelfarbe einfließen. Bei einem bilderfassenden System, das ein natürliches Bildsignal auf einer optischen Bildebene oder -zeile digitalisiert, bestimmt sich der entsprechende theoretische „Rekonstruktionsfilter“ (die Punktspreizfunktion) durch die optischen und elektronischen Elemente des Systems.

Es ist zwar möglich, Pixel als Quadrate zu betrachten, dies ist jedoch allenfalls dann sinnvoll, wenn als Rekonstruktionsfilter ein Box-Filter gewählt wurde, denn hier würde der Farbwert eines Pixels dem Mittelwert aller Farbbeiträge innerhalb des Quadrates entsprechen. Für die nachfolgende Bildbearbeitung muss jedoch das resultierende Pixel allgemein als diskreter Abtastwert betrachtet werden. Wenn von „einer Pixelbreite“ die Rede ist, dann ist damit tatsächlich der Abstand zwischen zwei benachbarten Pixeln gemeint; der „Mittelpunkt“ eines Pixels bezeichnet in Wirklichkeit das Pixel selbst. Mit Formulierungen wie „Überdeckung eines halben Pixels“ ist die Überdeckung der Bildinhalte durch den verwendeten Rekonstruktionsfilter gemeint.

Pixelwerte

Die im Pixel verwendete Kodierung der Farbe definiert sich unter anderem über den Farbraum und die Farbtiefe. Der einfachste Fall ist ein Binärbild, bei dem ein Pixel einen Schwarzweiß-Wert speichert.

Neben Farbinformationen können Rastergrafiken auch einen sogenannten Alphakanal enthalten, der Transparenzinformationen enthält. Die Speicherung beliebiger weiterer Informationen ist denkbar; das genaue Format ist vom verwendeten Grafikformat abhängig. Nur bei der Ausgabe auf dem Bildschirm muss ein bestimmtes Format beachtet werden, das vom Bildspeicher der Grafikkarte vorgegeben ist.

Probleme

Sowohl die Pixeldichte (und damit die örtliche Abtastrate) als auch die Größe der im Pixel gespeicherten Informationen (Farbtiefe, Farbkanäle, Lage, Form …) ist in der Praxis begrenzt, weshalb ein Pixel nur eine Annäherung der Wirklichkeit darstellen kann.

Die Begrenztheit der örtlichen Abtastrate führt dazu, dass Bildinformationen verlorengehen. Gemäß dem Nyquist-Shannon-Abtasttheorem kann es bei bestimmten Bildinhalten und zu geringer Abtastrate oder Pixeldichte zu Alias-Effekten oder dem Treppeneffekt („pixelige“ Darstellung) kommen. Diesen Effekten kann durch Antialiasing entgegengewirkt werden; das Antialiasing in der Computergrafik bedient sich dazu unterschiedlicher Methoden. Das Antialiasing optischer Signale kann durch einen Tiefpass erfolgen, kombiniert mit einer Aperturkorrektur.

Das Verkleinern, Vergrößern oder Drehen einer Rastergrafik kann zu unscharfen oder fehlerhaft wirkenden Bildern führen.

Pixel in Bildsensoren und Bildschirmen

| Der weiße Punkt in der Mitte des schwarzen Quadrats ist ein Pixel (sofern keine Zoom-Funktion verwendet wird). |

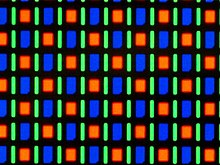

Die Pixel eines Bildsensors oder Bildschirms bestehen üblicherweise aus Flächen jeweils einer Grundfarbe (Rot, Grün und Blau). Bei Flüssigkristall-Bildschirmen (LCD= liquid crystal display) wird jedes sichtbare Bildelement mit einem Farbwert angesteuert. Die für die Grundfarben des Pixels zuständigen Flächen, Subpixel genannt, sind oftmals aneinander anliegend angeordnet. Die im Vergleich zum Pixel feinere Subpixelstruktur kann dazu genutzt werden, um die horizontale Auflösung bei der Rasterung zu erhöhen (Subpixel-Rendering). Ferner sind auch dreieckige, unregelmäßig große, alternierend angeordnete oder zusätzliche weiße Subpixel möglich, zum Beispiel bei den PenTile-Pixelgeometrien von Samsung. Bei manchen, besonders älteren Flachbildschirmen können herstellungsbedingt sogenannte Pixelfehler auftreten.

Röhrenbildschirme projizieren das Bildsignal mittels Elektronenstrahlen auf eine Leuchtstoffmatrix mit festgelegter Auflösung. Die vor der Leuchtstoffschicht montierte Schlitz-, Streifen- oder Lochmaske garantiert zwar, dass nur die zu den jeweiligen Elektronenstrahlen gehörenden Grundfarben angeregt werden. Wegen des relativ breiten und angenähert normalverteilten Intensitätsprofils der Elektronenstrahlen sowie Verzeichnung und Streulicht stimmen die Bildpunkte der Leuchtstoffmatrix jedoch nicht genau mit den zu erwartenden Pixeln überein, selbst wenn die ausgegebene Auflösung der physischen Auflösung des Röhrenbildschirms entspricht.

Die physische Größe eines Pixels hängt vom Gerät ab. Die Pixeldichte eines Bildschirms oder Scanners wird in pixel per inch (ppi) bzw. dots per inch (dpi) angegeben. Handelsübliche Computerbildschirme erreichen eine Pixeldichte von ungefähr 100 ppi, entsprechend 0,3 Millimeter pro Pixel. Bei Fernsehern ist die Pixeldichte meist niedriger und bei neueren Smartphones um ein Vielfaches höher, während die Sensoren von Scannern und Digitalkameras mehrere Tausend ppi erreichen können. Die Anzahl der in Bildsensoren maximal verwendbaren Pixel wird oft in Megapixeln angegeben, wobei aber meist nur die Farbpunkte eines Bayer-Sensors gemeint sind und nicht die Bildpunkte. Das Seitenverhältnis eines Pixels auf dem Bildschirm (englisch pixel aspect ratio) muss nicht zwingend 1:1 sein; die meisten SDTV-Videonormen schreiben unregelmäßige Pixel-Seitenverhältnisse vor. Die Pixelgröße sowie der Pixelabstand im Verhältnis zur Bildauflösung haben entscheidenden Einfluss auf die Lesbarkeit und Erkennbarkeit von Texten und Grafiken auf Computermonitoren und Fernsehern.

Begriffsgeschichte und verwandte Begriffe

Die Bezeichnung „Bildpunkt“ im Sinne einer kleinen Anzeigeeinheit eines Gerätes wurde zuerst 1884 in Paul Nipkows Patentschrift für sein Elektrisches Teleskop verwendet, allerdings war der Begriff bereits vorher in der Optik üblich.

Die Bezeichnung „picture element“ wurde ab 1911 in diversen US-amerikanischen Patentschriften verwendet. Als in den 1950er und 1960er Jahren das Einscannen, die Bearbeitung und die Anzeige von Bildern mittels Computern möglich wurde, verwendete die Fachliteratur meist andere Begriffe wie „resolution element“, „spot“, „sample“, „raster point“ oder „matrix element“.

Die ältesten bekannten Dokumente, in denen der Begriff „Pixel“ vorkommt, sind Fred C. Billingsleys 1965 veröffentlichte Artikel Digital Video Processing at JPL und Processing Ranger and Mariner Photography in den Proceedings Vol. 0003 bzw. 0010 der SPIE. Die weniger gebräuchliche Bezeichnung Pel wurde von William F. Schreiber als Teil seines Artikels Picture Coding in den IEEE-Proceedings Vol. 55 im März 1967 veröffentlicht.

Der Begriff „Pixel“ wird auch in Bezeichnungen für bestimmte Anwendungen von Rastergrafiken verwendet, etwa Pixelfonts, Pixel-Art und Pixel-Banner. Von „Pixel“ abgeleitet ist der Begriff Voxel, der unter anderem das dreidimensionale Äquivalent eines Pixels bezeichnet, sowie der in der Bildsynthese verwendete Begriff Texel für Pixel einer Textur.

Siehe auch

Literatur

- Michael Becker: Pixelsalat: von Bildschirmauflösungen, Zeichengrößen und Lesbarkeit. Computer-Fachwissen 3/2005: 4–10, ISSN 1430-0400.

- James Blinn: What is a Pixel? IEEE Computer Graphics and Applications 25, 5 (Sep./Oct. 2005): 82–87, ISSN 0272-1716, doi: 10.1109/MCG.2005.119

© biancahoegel.de

Datum der letzten Änderung: Jena, den: 23.12. 2025